在大数据时代,CPU服务器作为数据处理和分析的核心工具之一,承担着处理海量数据的重任。本文探讨了CPU服务器在大规模数据处理和分析中的关键角色,包括其硬件配置、优化策略、并行处理能力以及数据管理方法。通过了解这些方面,企业和数据工程师可以更有效地利用CPU服务器提升数据处理性能,从而支持更复杂的分析任务和业务决策。

一、 引言

随着数据量的急剧增加和业务需求的不断提升,传统的数据处理和分析方法已经无法满足现代企业的需求。CPU服务器,作为计算任务的核心平台,通过强大的处理能力和灵活的配置,为大规模数据处理提供了坚实的基础。本文将详细介绍如何充分发挥CPU服务器的优势,应对大规模数据处理和分析的挑战。

二、 硬件配置

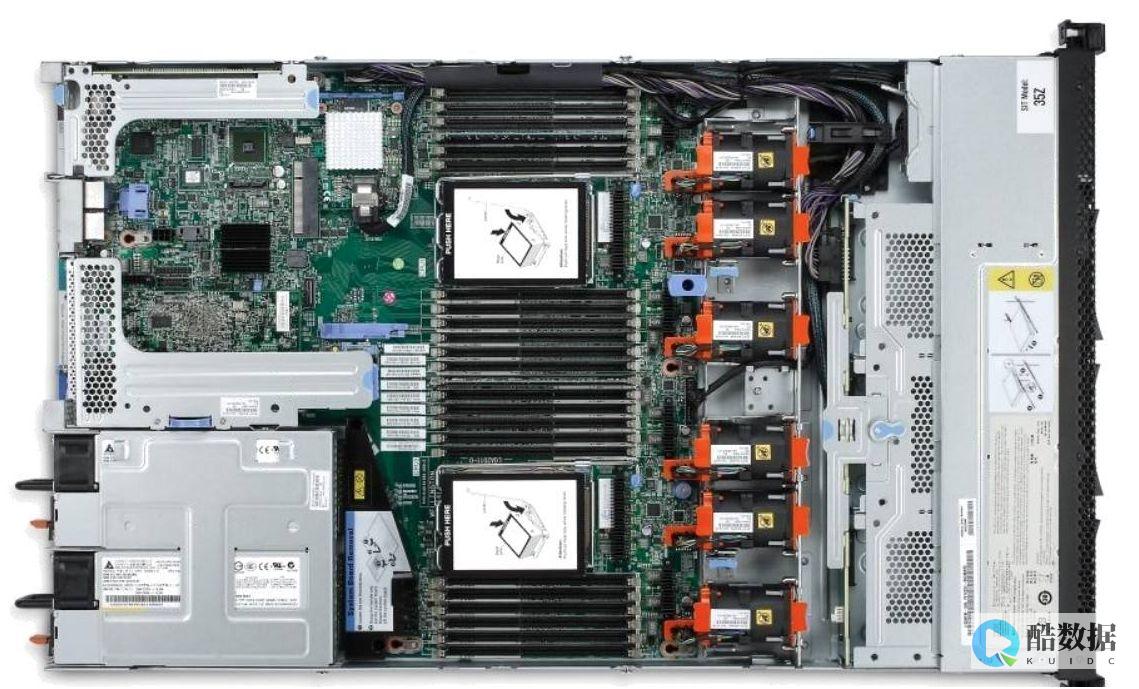

2.1 高性能处理器

大规模数据处理需要高性能的 CPU 支持。选择具备多核、高主频和大缓存的处理器能够显著提升数据处理速度。例如,现代CPU服务器通常配备多核处理器,如 Intel Xeon 或 AMD EPYC 系列,这些处理器能够高效地处理并发计算任务,提高整体处理能力。

2.2 大容量内存

内存的大小直接影响数据处理的效率。大容量内存能够提高数据的加载速度,并减少磁盘 I/O 操作对性能的影响。在大规模数据处理场景中,建议配置足够的内存,以确保处理器能够快速访问和处理数据。

2.3 快速存储系统

除了 CPU 和内存,存储系统也是数据处理性能的关键因素。选择高速 SSD 或 NVMe 存储设备,可以显著缩短数据读取和写入时间,提升整体系统性能。

三、 优化策略

3.1 并行处理

现代CPU服务器通常支持多线程和并行处理,通过将计算任务分配到多个核心和线程上,可以显著提高数据处理速度。利用并行计算框架,如 Apache Spark 或 Hadoop,可以有效地分配计算负载,处理大规模数据集。

3.2 数据预处理

在数据分析之前,对数据进行预处理是提高处理效率的关键步骤。包括数据清洗、归一化和格式转换等操作,可以减少数据处理过程中的复杂度,提升处理速度和准确性。

3.3 优化算法

选择适合的数据处理算法也是提升性能的关键。优化算法设计、减少计算复杂度和使用高效的编程语言和库(如 Python 的 NumPy 和 Pandas)可以显著提升数据分析的效率。

四、 数据管理

4.1 数据分片与分区

对于大规模数据集,将数据分片或分区可以有效地管理数据存储和访问。通过将数据分割成更小的部分,可以减少单个操作的数据量,从而提高处理速度。

4.2 数据缓存

使用数据缓存机制可以减少对存储系统的频繁访问,提高数据访问速度。内存缓存和分布式缓存系统(如 Redis)能够有效地存储和管理热点数据,加快数据处理过程。

4.3 数据备份与恢复

大规模数据处理中的数据备份和恢复策略同样重要。定期备份数据,并制定高效的数据恢复方案,可以确保在数据丢失或损坏时迅速恢复系统运行,保障数据安全。

五、 结论

CPU服务器在大规模数据处理和分析中扮演着至关重要的角色。通过合理配置硬件、实施优化策略、管理数据及其存储方式,可以显著提升数据处理的效率和性能。了解和应用这些策略,企业和数据工程师能够更有效地应对大数据挑战,支持复杂的分析任务和业务决策,推动数据驱动的创新和发展。

好主机测评广告位招租-300元/3月多线程处理时,并发量过大时该如何避免服务器崩溃

尽量使用缓存,包括用户缓存,信息缓存等,多花点内存来做缓存,可以大量减少与数据库的交互,提高性能。 1、用jprofiler等工具找出性能瓶颈,减少额外的开销。 优化数据库查询语句,减少直接使用hibernate等工具的直接生成语句(仅耗时较长的查询做优化)。 优化数据库结构,多做索引,提高查询效率。 2、统计的功能尽量做缓存,或按每天一统计或定时统计相关报表,避免需要时进行统计的功能。 3、能使用静态页面的地方尽量使用,减少容器的解析(尽量将动态内容生成静态html来显示)。 4、解决以上问题后,使用服务器集群来解决单台的瓶颈问题。 基本上以上述问题解决后,达到系统最优。

Java面试总结如何处理项目的高并发,大数据

这个很简单,高并发有多种解决方法: 1、从代码上分入手,必须得保证代码没有冗余,不要有废代码; 2、从服务器上入手,高并发一台服务器并发量有限,我们可以采用多台服务器来分担压力; 3、从存储方便入手,像我们一般高并发但是数据却可以不...

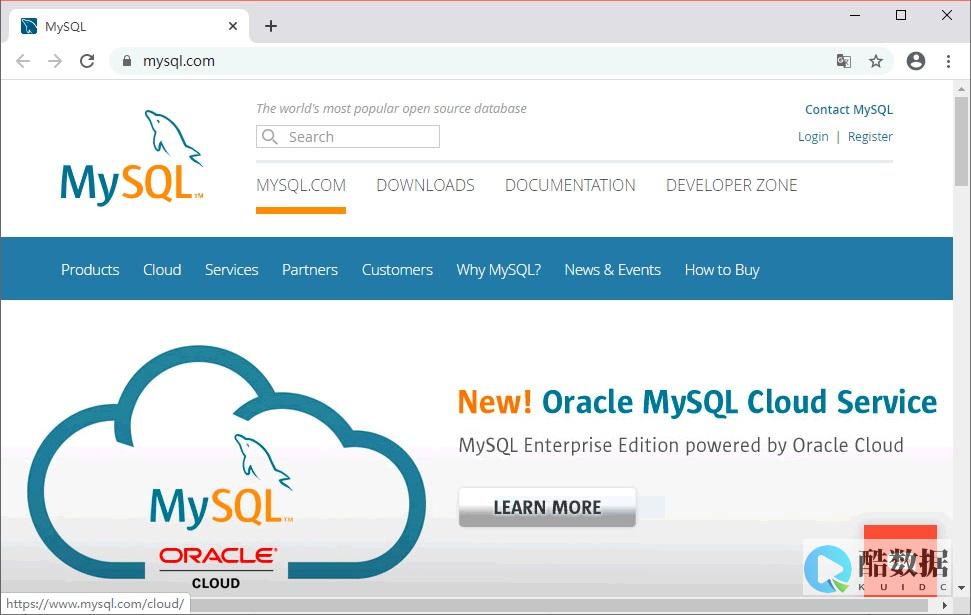

如何处理海量数据

在实际的工作环境下,许多人会遇到海量数据这个复杂而艰巨的问题,它的主要难点有以下几个方面:一、数据量过大,数据中什么情况都可能存在。 如果说有10条数据,那么大不了每条去逐一检查,人为处理,如果有上百条数据,也可以考虑,如果数据上到千万级别,甚至 过亿,那不是手工能解决的了,必须通过工具或者程序进行处理,尤其海量的数据中,什么情况都可能存在,例如,数据中某处格式出了问题,尤其在程序处理时, 前面还能正常处理,突然到了某个地方问题出现了,程序终止了。 二、软硬件要求高,系统资源占用率高。 对海量的数据进行处理,除了好的方法,最重要的就是合理使用工具,合理分配系统资源。 一般情况,如果处理的数据过TB级,小型机是要考虑的,普通的机子如果有好的方法可以考虑,不过也必须加大CPU和内存,就象面对着千军万马,光有勇气没有一兵一卒是很难取胜的。 三、要求很高的处理方法和技巧。 这也是本文的写作目的所在,好的处理方法是一位工程师长期工作经验的积累,也是个人的经验的总结。 没有通用的处理方法,但有通用的原理和规则。 下面我们来详细介绍一下处理海量数据的经验和技巧:一、选用优秀的数据库工具现在的数据库工具厂家比较多,对海量数据的处理对所使用的数据库工具要求比较高,一般使用Oracle或者DB2,微软 公司最近发布的SQL Server 2005性能也不错。 另外在BI领域:数据库,数据仓库,多维数据库,数据挖掘等相关工具也要进行选择,象好的ETL工具和好的OLAP工具都十分必要, 例如Informatic,Eassbase等。 笔者在实际数据分析项目中,对每天6000万条的日志数据进行处理,使用SQL Server 2000需要花费6小时,而使用SQL Server 2005则只需要花费3小时。 二、编写优良的程序代码处理数据离不开优秀的程序代码,尤其在进行复杂数据处理时,必须使用程序。 好的程序代码对数据的处理至关重要,这不仅仅是数据处理准确度的问题,更是数据处理效率的问题。 良好的程序代码应该包含好的算法,包含好的处理流程,包含好的效率,包含好的异常处理机制等。 三、对海量数据进行分区操作对海量数据进行分区操作十分必要,例如针对按年份存取的数据,我们可以按年进行分区,不同的数据库有不同的分区方式,不 过处理机制大体相同。 例如SQL Server的数据库分区是将不同的数据存于不同的文件组下,而不同的文件组存于不同的磁盘分区下,这样将数据分散开,减小磁盘I/O,减小了系统负荷, 而且还可以将日志,索引等放于不同的分区下。 四、建立广泛的索引对海量的数据处理,对大表建立索引是必行的,建立索引要考虑到具体情况,例如针对大表的分组、排序等字段,都要建立相应 索引,一般还可以建立复合索引,对经常插入的表则建立索引时要小心,笔者在处理数据时,曾经在一个ETL流程中,当插入表时,首先删除索引,然后插入完 毕,建立索引,并实施聚合操作,聚合完成后,再次插入前还是删除索引,所以索引要用到好的时机,索引的填充因子和聚集、非聚集索引都要考虑。 五、建立缓存机制当数据量增加时,一般的处理工具都要考虑到缓存问题。 缓存大小设置的好差也关系到数据处理的成败,例如,笔者在处理2亿条数据聚合操作时,缓存设置为条/Buffer,这对于这个级别的数据量是可行的。 六、加大虚拟内存如果系统资源有限,内存提示不足,则可以靠增加虚拟内存来解决。 笔者在实际项目中曾经遇到针对18亿条的数据进行处理, 内存为1GB,1个P42.4G的CPU,对这么大的数据量进行聚合操作是有问题的,提示内存不足,那么采用了加大虚拟内存的方法来解决,在6块磁盘分区 上分别建立了6个4096M的磁盘分区,用于虚拟内存,这样虚拟的内存则增加为 4096*6 + 1024 = M,解决了数据处理中的内存不足问题。 七、分批处理海量数据处理难因为数据量大,那么解决海量数据处理难的问题其中一个技巧是减少数据量。 可以对海量数据分批处理,然后处 理后的数据再进行合并操作,这样逐个击破,有利于小数据量的处理,不至于面对大数据量带来的问题,不过这种方法也要因时因势进行,如果不允许拆分数据,还 需要另想办法。 不过一般的数据按天、按月、按年等存储的,都可以采用先分后合的方法,对数据进行分开处理。 八、使用临时表和中间表数据量增加时,处理中要考虑提前汇总。 这样做的目的是化整为零,大表变小表,分块处理完成后,再利用一定的规则进行合 并,处理过程中的临时表的使用和中间结果的保存都非常重要,如果对于超海量的数据,大表处理不了,只能拆分为多个小表。 如果处理过程中需要多步汇总操作, 可按汇总步骤一步步来,不要一条语句完成,一口气吃掉一个胖子。 九、优化查询SQL语句在对海量数据进行查询处理过程中,查询的SQL语句的性能对查询效率的影响是非常大的,编写高效优良的SQL脚本和存储 过程是数据库工作人员的职责,也是检验数据库工作人员水平的一个标准,在对SQL语句的编写过程中,例如减少关联,少用或不用游标,设计好高效的数据库表 结构等都十分必要。 笔者在工作中试着对1亿行的数据使用游标,运行3个小时没有出结果,这是一定要改用程序处理了。 十、使用文本格式进行处理对一般的数据处理可以使用数据库,如果对复杂的数据处理,必须借助程序,那么在程序操作数据库和程序操作文本之间选择, 是一定要选择程序操作文本的,原因为:程序操作文本速度快;对文本进行处理不容易出错;文本的存储不受限制等。 例如一般的海量的网络日志都是文本格式或者 csv格式(文本格式),对它进行处理牵扯到数据清洗,是要利用程序进行处理的,而不建议导入数据库再做清洗。 十一、定制强大的清洗规则和出错处理机制海量数据中存在着不一致性,极有可能出现某处的瑕疵。 例如,同样的数据中的时间字段,有的可能为非标准的时间,出现的原因可能为应用程序的错误,系统的错误等,这是在进行数据处理时,必须制定强大的数据清洗规则和出错处理机制。 十二、建立视图或者物化视图视图中的数据来源于基表,对海量数据的处理,可以将数据按一定的规则分散到各个基表中,查询或处理过程中可以基于视图进行,这样分散了磁盘I/O,正如10根绳子吊着一根柱子和一根吊着一根柱子的区别。 十三、避免使用32位机子(极端情况)目前的计算机很多都是32位的,那么编写的程序对内存的需要便受限制,而很多的海量数据处理是必须大量消耗内存的,这便要求更好性能的机子,其中对位数的限制也十分重要。 十四、考虑操作系统问题海量数据处理过程中,除了对数据库,处理程序等要求比较高以外,对操作系统的要求也放到了重要的位置,一般是必须使用服务器的,而且对系统的安全性和稳定性等要求也比较高。 尤其对操作系统自身的缓存机制,临时空间的处理等问题都需要综合考虑。 十五、使用数据仓库和多维数据库存储数据量加大是一定要考虑OLAP的,传统的报表可能5、6个小时出来结果,而基于Cube的查询可能只需要几分钟,因此处理海量数据的利器是OLAP多维分析,即建立数据仓库,建立多维数据集,基于多维数据集进行报表展现和数据挖掘等。 十六、使用采样数据,进行数据挖掘基于海量数据的数据挖掘正在逐步兴起,面对着超海量的数据,一般的挖掘软件或算法往往采用数据抽样的方式进行处理,这样 的误差不会很高,大大提高了处理效率和处理的成功率。 一般采样时要注意数据的完整性和,防止过大的偏差。 笔者曾经对1亿2千万行的表数据进行采样,抽取出 400万行,经测试软件测试处理的误差为千分之五,客户可以接受。 还有一些方法,需要在不同的情况和场合下运用,例如使用代理键等操作,这样的好处是加快了聚合时间,因为对数值型的聚合比对字符型的聚合快得多。 类似的情况需要针对不同的需求进行处理。 海量数据是发展趋势,对数据分析和挖掘也越来越重要,从海量数据中提取有用信息重要而紧迫,这便要求处理要准确,精度要高,而且处理时间要短,得到有价值信息要快,所以,对海量数据的研究很有前途,也很值得进行广泛深入的研究。

发表评论